Responsible IT op de Ring

Steeds meer organisaties integreren Artificial Intelligence (AI)-technieken en -tools in hun processen. Voorbeelden hiervan zijn generatieve AI voor het maken van beelden, video’s en teksten, evenals classificatietaken die vaak worden ingezet in de medische sector en de industrie. Hoewel de nadruk vaak ligt op de nauwkeurigheid en prestaties van AI-modellen, bestaat het risico dat belangrijke aspecten zoals eerlijkheid, inclusiviteit en duurzaamheid worden verwaarloosd.

Organisaties erkennen steeds meer de noodzaak van een verantwoorde AI-ontwikkeling. Het lectoraat Responsible IT van de Hogeschool van Amsterdam (HvA) heeft een KIEM High Tech-subsidie ontvangen om organisaties te helpen om weloverwogen keuzes te maken bij de ontwikkeling en inzet van AI-systemen. Met deze subsidie gaan onderzoekers van het lectoraat werken aan de ontwikkeling van het Applied Artificial Intelligence Trade-Off Dashboard. Dit dashboard biedt inzicht in de afwegingen tussen technische prestaties, eerlijkheid en duurzaamheid, zodat organisaties de werkelijke kosten van AI-systemen beter kunnen inschatten.

Zo kan een AI-model dat beter presteert op globaal niveau, slechter functioneren voor specifieke kwetsbare groepen. Daarnaast kunnen modellen met hoge prestaties aanzienlijk veel energie vergen voor training en gebruik, wat een negatieve impact heeft op het milieu. Informatie hierover ontbreekt nu veelal in het ontwikkelproces, waardoor organisaties enkel kiezen op basis van technische prestaties. Dit dashboard helpt organisaties om de daadwerkelijke prestaties en kosten van een AI-model beter in te schatten.

“AI is een technologie die veel nieuwe mogelijkheden biedt, maar die ook de nodige ethische en maatschappelijke vragen met zich meebrengt, o.a. ten aanzien van discriminatie en op het gebied van duurzaamheid. Het is daarom belangrijk om bij de ontwikkeling en inzet deze aspecten al mee te nemen om tot verantwoorde AI te komen. We zien dat organisaties dit ook willen, maar vaak niet weten waar te beginnen. Met dit project kunnen we AI-ontwikkelaars meer handelingsperspectief bieden.”

Dit initiatief benadrukt het groeiende besef dat technologische vooruitgang hand in hand moet gaan met maatschappelijke verantwoordelijkheid. Het verantwoord ontwikkelen van AI-systemen zorgt ervoor dat de voordelen van deze technologie breed gedeeld kunnen worden, terwijl de negatieve gevolgen voor kwetsbare groepen en het milieu zoveel mogelijk worden beperkt.

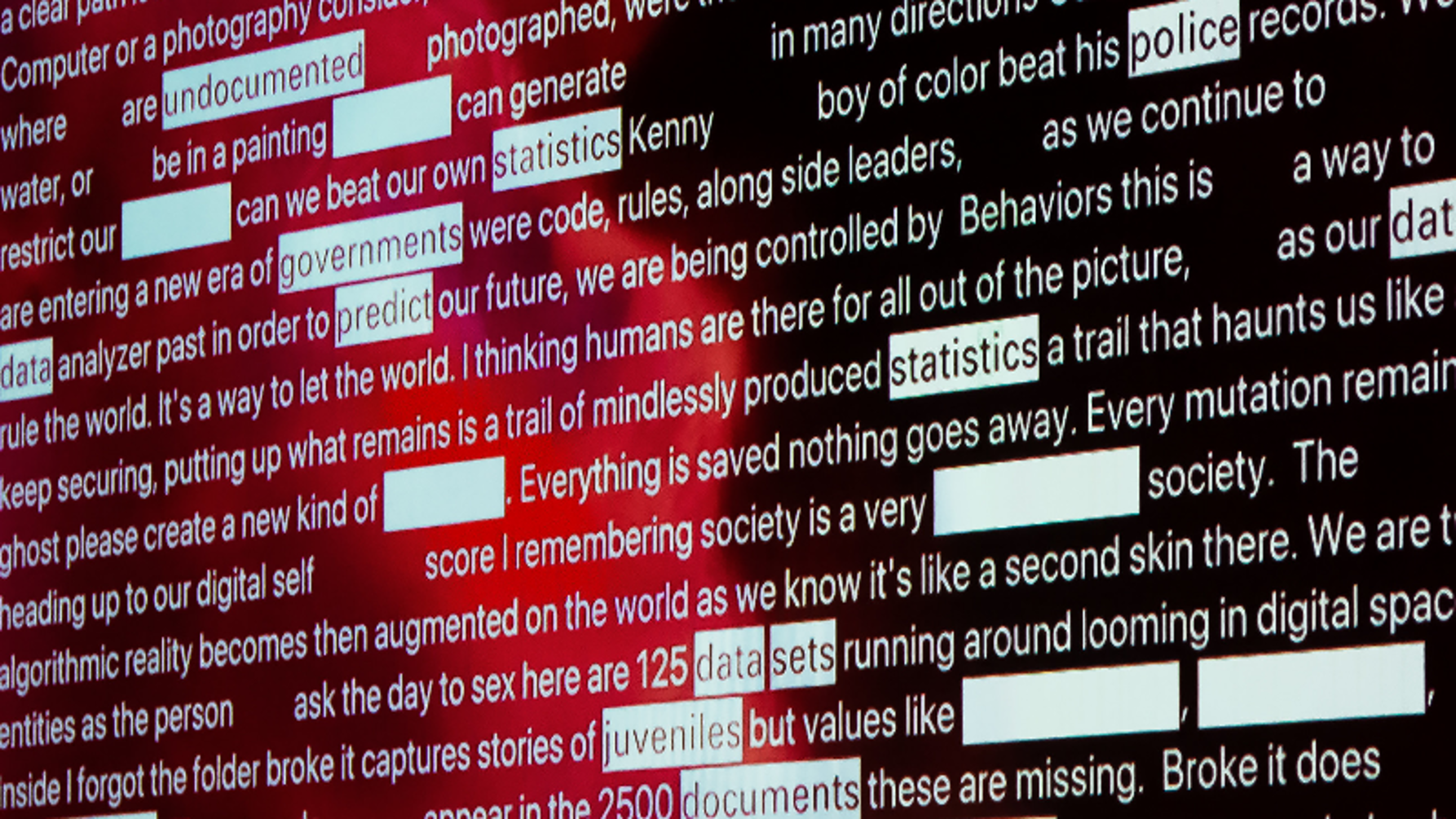

Ontsnappen is onmogelijk: zodra we een ruimte instappen, zijn we verbonden met algoritmes en worden data verzameld. Technologie is inmiddels overal . “Kunnen we het bedenken, dan wordt het gemaakt”, vat Frank Kresin samen, decaan van de faculteit Digitale Media en Creatieve Industrie. Hoe moeten we als samenleving omgaan met die sterke verwevenheid met technologie? Een gesprek met decaan Frank Kresin en senior-onderzoeker Esther Hammelburg van de Hogeschool van Amsterdam (faculteit Digitale Media en Creatieve Industrie).

De samenleving is een fase ingegaan waarin we altijd en overal verbonden zijn door en met technologie. Die continue verwevenheid biedt kansen- van de zorg tot de industrie- maar er zitten ook grote risico’s aan. Zoals verlies van privacy, aantasting van mensenrechten en vervuiling, door afgedankte apparaten en energieverbruik.

Het is dan ook urgent om als samenleving en vanuit het hoger onderwijs een visie te formuleren voor hoe we willen omgaan met die nieuwe werkelijkheid. “Als we nu niet nadenken over de gevolgen van die continue verbondenheid, bestaat het risico dat menselijke waarden, en de belangen van andere levende wezens en de planeet als geheel in het gedrang komen,” aldus Esther Hammelburg, media-onderzoeker aan de HvA.

“Technologie moet de maatschappij als geheel dienen. Daarvoor is nodig om mensen eigenaarschap en handelingsperspectief te geven, en systemen te dwingen tot transparantie en wederkerigheid”, voegt decaan Frank Kresin toe. “Die visie biedt een duidelijk uitgangspunt voor het hoger onderwijs.”

Decaan Frank Kresin: “De aanleiding is, basaal gezegd, dat door technologische mogelijkheden alles nu een mate van rekenkracht krijgt- sommige mensen noemen dat intelligentie – en je vrijwel continu in contact staat met algoritmes en data. Eerder zat die rekenkracht in fabrieken en op je bureau, nu is ze overal om ons heen en dragen we haar met ons mee.

Aan de ene kant geven alle technologische mogelijkheden de samenleving kracht. Denk aan sensoren die signaleren dat iemand valt, of geavanceerde AI-modellen die ervoor zorgen dat medische aandoeningen eerder opgespoord worden.

Maar er zit ook een enorm risico in op controle en repressie. Wat afwijkt van de norm is verdacht. Technologie – en wie haar bezit – ‘weet’ meer over jou dan je partner, dan jijzelf, vergeet nooit meer iets en kan alle data met elkaar verbinden. Dat kun je, als je kwaadwillend bent, gebruiken om iemand te controleren of te manipuleren.

Het is een machtig spanningsveld. Technologie kán een kracht voor verbetering zijn, maar alleen als er in het ontwerp en de uitvoering al bepaalde waarden zijn verwerkt – van autonomie, van wederkerigheid en het versterken van gemeenschapszin.”

Diezelfde mogelijkheden én schaduwkanten zien we ook wanneer technologie wordt ingezet voor menselijke interactie, stelt media-onderzoeker Esther Hammelburg. “Neem de opmars van A.I. bij rouwverwerking, waarbij nabestaanden dankzij gepersonaliseerde chatbots als het ware nog kunnen ‘praten’ met een overledene. Dit kán helpen bij rouw- mits goed ontworpen en gebruikt- maar het kan net zo goed de verwerking in de weg staan.

Lost technologie hier daadwerkelijk een probleem op en verrijkt het ons leven? Of lopen we het risico essentiële vaardigheden – zoals het nemen van afscheid – kwijt te raken door het uit te besteden, en worden we als rouwenden speelbal van bedrijven die aan ons verdriet verdienen? Idealiter staan we al bij deze vragen stil voordat de mogelijkheden zich voordoen.”

Technologie – en wie haar bezit – ‘weet’ meer over jou dan je partner, dan jijzelf, vergeet nooit meer iets en kan alle data met elkaar verbinden. Dat kun je, als je kwaadwillend bent, gebruiken om iemand te controleren of te manipuleren. Het is een machtig spanningsveld.

Frank Kresin

Decaan HvA-faculteit Digitale Media en Creatieve Industrie

Frank Kresin: “Dat de samenleving sterk technologisch gedreven raakt, betekent dat we als hogeschool, waar we nieuwe technologie als A.I. en quantumcomputing ontwikkelen en toepassen, een grote verantwoordelijkheid hebben. Enerzijds doen we dat door te kijken: hoe ontwerp je? Een voorbeeld zijn AI-systemen die we ontwikkelen voor onder meer gemeente Amsterdam, waarin de onderzoekers en studenten zoveel mogelijk rekening houden met privacy van burgers en gegevens niet uitwisselen met ‘the cloud’, maar deze veilig en lokaal analyseren.

Anderzijds is het onze taak om de digitale weerbaarheid te vergroten van studenten, collega’s, professionals en burgers. Zij moeten onder de motorkap kijken en grip krijgen op wat er gaande is.

Uiteindelijk draait het om mensen handelingsperspectief bieden, zodat zij– collectief en individueel – de mogelijkheden van technologie ten goede kunnen gebruiken. En er niet door gecontroleerd, gemanipuleerd of beperkt worden.”

“We hebben binnen het hoger onderwijs lang gedacht dat je maatschappelijke fenomenen geïsoleerd kon bestuderen, per vakgebied”, zegt Frank Kresin. “Dit is veranderd door de opkomst van digitalisering en grote thema’s als klimaatverandering, waarbij we hebben gezien dat werkelijk álles op elkaar ingrijpt. Toegepast onderzoek neemt juist die maatschappelijke context mee, en dat is waar de effecten van technologie zich tonen.

Wij brengen de techniek naar de plekken waar deze daadwerkelijk een rol speelt: zoals de inzet van AI bij zorginstellingen, binnen de rechtspraktijk of voor preventief onderhoud aan machineparken. Daarbij is steeds het uitgangspunt om de techniek uit het lab zodanig in te zetten, dat deze recht doet aan de publieke waarden die we met elkaar hebben.

Onze studenten en onderzoekers zitten op het gemeentehuis. waar zij bijvoorbeeld aan een project werken om ambtelijke teksten leesbaarder te maken met AI, bij het UWV, op de Bijlmerscholengemeenschap en bij bedrijven. Kortom: in alle sectoren waar oplossingen nodig zijn en ook de effecten zichtbaar worden. We nemen zo meteen burgers en werknemers mee in het bewustzijn over technologie en de implicaties ervan.”

Ook Esther Hammelburg benadrukt het belang van praktijkgericht onderzoek voor innovatie: “Toegepast onderzoek vertrekt vanuit de context, en stelt daarom altijd de vraag hoe technologie binnen de maatschappij vorm moet krijgen. Het gaat hier dus niet om tech for tech’s sake, maar om maatschappelijk gedreven innovatie.

Op dit moment werk ik bijvoorbeeld samen met collega’s van het lectoraat Civic Interaction Design. de Radboud Universiteit en Universiteit Utrecht aan alternatieven voor bestaande online platforms als Facebook en Instagram. We hebben veilige online ruimten nodig die niet worden gedreven door commercieel belang; waarin publieke waarden centraal staan. Hieraan is maatschappelijk behoefte, en het is noodzakelijk om de democratie te beschermen.”

Frank Kresin: “We staan al midden in die overgang naar een samenleving waarin alles en iedereen voortdurend verbonden is met technologie. Als je je aan algoritmes en dataverzameling wilt onttrekken, moet je veel moeite doen. Ieder mobieltje en iedere smartwatch zou je in een diepvries of metalen kist moeten leggen, om te zorgen dat deze niet doorgeeft waar die is. Als je in deze maatschappij staat, heb je daarmee te dealen.”

Ondanks dat de mogelijkheden oneindig lijken, staan volgens Kresin de antwoorden over waar de grens ligt nog niet vast. “Daarom moeten alle vakgebieden – van techniek tot filosofie tot kunst en ontwerp – samen nadenken over grenzen, kansen en gevaren. We zijn hier aan de Hogeschool van Amsterdam uitstekend gepositioneerd om daarover na te denken. Dat doen we samen met ons netwerk, met bedrijven, de creatieve sector en kennispartners.”

Esther Hammelburg: “Dit begrip verwijst naar een nieuwe fase van de samenleving – na de fases van industrialisatie en digitalisering- waarin we voortaan overal verbonden zijn met technologie. Society 5.0 staat voor een samenleving waarin technologie wordt ingezet vóór menselijke waarden en de gemeenschap. In Japan vormt het niet alleen een visie, maar zelfs een strategie om het land vooruit te helpen, met als doel brede welvaart.

Ook voor Nederland biedt Society 5.0 een wenkend langetermijnperspectief, waaraan hogeronderwijsinstellingen, zoals de HvA, kunnen samenwerken met beleidsmakers, overheden en bedrijven.”

Frank Kresin: “Wat ik onbegrijpelijk vind, is dat dit kabinet willens en wetens de blik op de toekomst heeft verruild op gisteren en eergisteren. Wat je ziet gebeuren, is dat er met de retoriek ‘we zijn er voor de mensen’ snoeihard wordt bezuinigd op onderwijs en onderzoek. Terwijl daarmee juist een handelingsperspectief wordt ontwikkeld. Dáármee wordt geïnvesteerd in burgerschap, economische en maatschappelijke vooruitgang én verdienvermogen.

We zouden met het hoger onderwijs juist een voorlopersrol in de wereld kunnen spelen door technologie en reflectie sterker met elkaar te verbinden. Bezuinig je op de kenniseconomie, dan bezuinig je op die potentie en denk je niet aan consequenties op lange termijn.”

___________________________________________________________________________________________

Aanrader: festival rond Society 5.0

Onderdeel van de programmalijn Society 5.0 is het gelijknamige toekomstfestival dat de HvA, Rietveld Academie, Inholland en AHK (verenigd in het Centre of Expertise for Creative Innovation(opent in nieuw venster)) samen jaarlijks organiseren. Esther Hammelburg is tevens directeur van dit festival.

De volgende editie van het Society 5.0 Festival(opent in nieuw venster) is op 15 & 16 oktober 2025.

Een nieuwe speler in de AI-wedloop zorgt voor opschudding: het Chinese AI-model Deepseek zou qua prestaties niet onderdoen voor Amerikaanse tegenhangers zoals ChatGPT, maar is tegen een fractie van de kosten ontwikkeld. @RTL Z Nieuws sprak lector Responsible AI Pascal Wiggers om deze doorbraak te duiden en de impact ervan op de AI-markt en geopolitieke machtsverhoudingen te analyseren.

Een belangrijke reden voor de efficiëntie van Deepseek is de manier waarop het model zichzelf verbetert. “Ze gebruiken reinforcement learning, waarbij AI leert van fouten, maar met veel minder menselijke tussenkomst dan bij andere bedrijven. Het gebeurt vrijwel volautomatisch,” legt Wiggers uit.

Toch plaatst hij een kanttekening bij het genoemde budget van slechts 6 miljoen dollar. “Dit bedrag betreft alleen de rekencapaciteit voor het trainen van het model. Maar nergens wordt vermeld wat het heeft gekost om de benodigde data – triljoenen woorden en 800.000 handmatig gecontroleerde documenten – te verzamelen en corrigeren. Zulke arbeidskosten zijn aanzienlijk hoger.”

Hoewel Deepseek een serieuze stap vooruit is, nuanceert Wiggers het idee dat China nu op gelijke hoogte staat met de VS. “Een cybersecurity-bedrijf ontdekte dat Deepseek gevoeliger is voor schadelijke en ongewenste uitspraken dan Amerikaanse modellen. Daarnaast richt Deepseek zich voornamelijk op Chinees en Engels, terwijl westerse AI-modellen een breder scala aan talen aankunnen. Op details liggen de Amerikanen dus nog voor, maar China heeft absoluut een inhaalslag gemaakt.”

Terwijl Amerikaanse bedrijven honderden miljarden in AI investeren, stelt Europa slechts 1,5 miljard eurobeschikbaar. Is dat voldoende om te concurreren? Volgens Wiggers biedt Deepseek een interessante boodschap: “Met minder geld kun je alsnog grote stappen zetten. Dit opent de deur naar nieuwe kansen voor Europa.”

Terugkijken? Bekijk het item vanaf 1:50 min in RTL Z Nieuws – 11:00 uur(opent in nieuw venster).